Die Integration von Künstlicher Intelligenz in den Unterricht gleicht oft einem Blindflug. Entweder wird sie pauschal verboten ("Schummel-Tool") oder unkritisch gefeiert ("Zukunftstechnologie"). Was fehlt, ist ein differenzierter Blick: Wann ist KI lernförderlich – und wann nicht?

Unser Modell A: Didaktik & Kognitive Souveränität wurde entwickelt, um genau diese Lücke zu schließen. Es ist kein Technik-Leitfaden, sondern ein pädagogisches Framework. Es hilft Lehrpersonen, KI so einzusetzen, dass Schüler:innen kompetenter werden, nicht bequemer.

Das Problem: Die Kompetenzfalle

Generative KI kann Texte schreiben, Bilder malen und Code programmieren. Das ist faszinierend, birgt aber eine Gefahr: Wenn Schüler:innen diese Aufgaben an die KI delegieren, bevor sie die zugrundeliegenden Kompetenzen selbst erworben haben, entsteht eine "Kompetenzfalle". Sie produzieren zwar gute Ergebnisse, verstehen aber den Prozess nicht.

"Wer den Prozess nicht beherrscht, kann das Ergebnis nicht beurteilen. Kognitive Souveränität bedeutet, die Wahl zu haben: Delegieren oder Selbermachen."

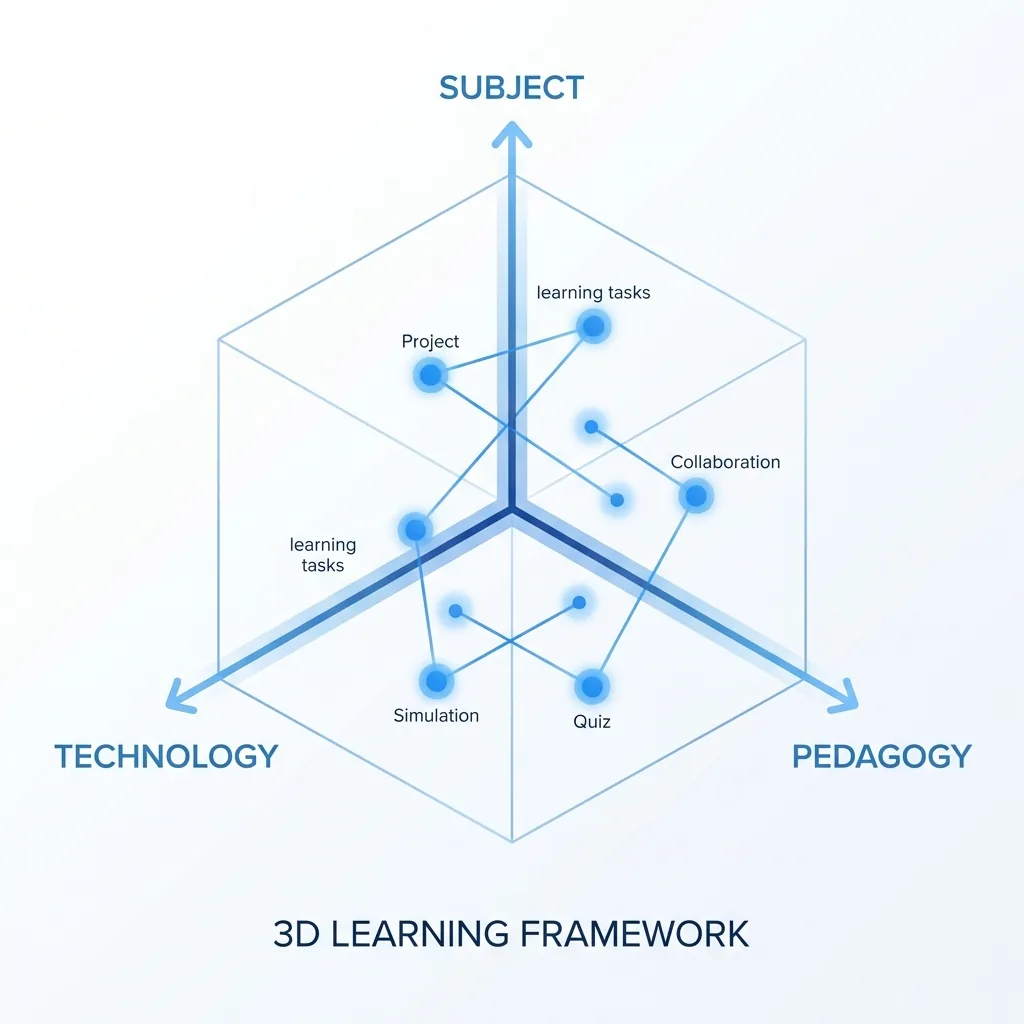

Die Lösung: Das 3D-Koordinatensystem

Kernstück des Modells ist ein dreidimensionales Koordinatensystem, mit dem jede Lernaufgabe verortet werden kann. Statt "KI ja/nein" fragen wir nach drei Dimensionen:

- X-Achse: Taxonomie-Stufe (Was soll gelernt werden? Erinnern vs. Erschaffen)

- Y-Achse: KI-Intensität (Wie stark greift die KI ein? Assistenz vs. Autonomie)

- Z-Achse: Menschliche Kontrolle (Wer hat das letzte Wort? Human-in-the-loop vs. Automation)

Daraus ergeben sich vier klare Modi:

- Verbots-Modus (Red Zone): Hier lernen Schüler:innen die Grundlagen. KI ist tabu, damit neuronale Netze im Gehirn entstehen, nicht auf dem Server.

- Dialog-Modus (Yellow Zone): KI als Sokratischer Partner. Sie stellt Fragen, gibt Feedback, aber löst nicht.

- Hybrid-Modus (Green Zone): Arbeitsteilung. Der Mensch gibt die Strategie vor, die KI exekutiert Teilaufgaben (z.B. Recherche, Stilstruktur).

- Autopilot-Modus (Blue Zone): Vollständige Delegation. Nur für Experten zulässig, die das Ergebnis validieren können.

9 Axiome als Fundament

Das Modell ruht auf 9 nicht-verhandelbaren Grundsätzen (Axiomen). Drei davon sind besonders entscheidend:

- Axiom 1: Primat der Pädagogik. Technik folgt Didaktik, nicht umgekehrt. Wir nutzen KI nur, wenn sie einen didaktischen Mehrwert bietet.

- Axiom 4: Human-in-the-Loop. Es darf keine vollautomatische Entscheidung über Menschen geben (z.B. bei der Notengebung).

- Axiom 7: Transparenzgebot. Jede KI-Nutzung muss offengelegt werden. Wer KI nutzt, muss erklären können, warum und wie.

12 Interventionen für die Praxis

Theorie ist gut, Praxis ist besser. Das Modell bietet 12 konkrete Unterrichtsformate ("Interventionen"), die sofort umsetzbar sind:

- Der Sokratische Begleiter: Ein Prompt, der die KI anweist, nur Fragen zu stellen, statt Antworten zu geben.

- Die Fehler-Suche: Die KI generiert einen halluzinierenden Text, Schüler:innen müssen die Fehler finden (fördert kritisches Denken).

- Die Perspektiven-Maschine: "Erkläre den Klimawandel aus der Sicht eines Öl-Lobbyisten und eines Klima-Aktivisten." (Fördert Perspektivübernahme).

Fazit: Vom Konsumenten zum Gestalter

Ziel des Modells ist nicht, KI-Experten auszubilden, sondern mündige Bürger:innen. Menschen, die KI als Werkzeug nutzen, um ihre eigenen kognitiven Fähigkeiten zu erweitern, statt sie zu ersetzen. Das nennen wir Kognitive Souveränität.

Nutzen Sie das Modell, um Ihren Unterricht zu planen. Fragen Sie bei jeder Aufgabe: In welchem Modus sind wir? Und: Wer lernt hier gerade – der Mensch oder die Maschine?